La guerre cognitive n’est pas une nouveauté. Mais elle a changé de visage. Avec les réseaux sociaux, l’intelligence artificielle générative et la concentration du pouvoir algorithmique entre quelques mains, la bataille pour les esprits est devenue massive, permanente et accessible au plus grand nombre.

Pour en comprendre les mécaniques, nous nous sommes entretenus avec le commandant Samuel Henry, spécialiste des biais cognitifs au sein de l’État-major des armées. En 2025, il a reçu le Prix ACADEM Jeunesse pour son travail de vulgarisation des mécanismes de la désinformation.

Question : Quelle est votre définition de la guerre cognitive ?

Samuel Henry : La guerre cognitive, c’est une nouvelle appellation d’un enjeu qui est persistant dans la guerre : agir sur les convictions, conquérir les esprits. On remonte très loin, comme le disait Sun Tzu, gagner le combat sans ensanglanter la lame, c’est le fin du fin. Depuis lors, cet aspect lié aux mécaniques de persuasion et de perception n’a cessé d’évoluer, parce que la manière dont les messages se diffusent n’a cessé d’évoluer. Et ça s’est considérablement accéléré avec l’avènement des réseaux sociaux, au cours des dix ou vingt dernières années.

Une des meilleures définitions que j’aie trouvées est celle du général Olivier Pinard Legry, dans un article de la Revue Défense Nationale, en 2022. Il distingue trois stades dans la guerre cognitive. Le premier agit sur le message, par la répétition et la réitération : c’est la propagande classique. Le deuxième agit sur le vecteur : ça transforme la donne, parce que ça permet de massifier les diffusions, d’agir à bas coût, de manière massive et beaucoup plus efficace. Le troisième stade, qu’on n’a pas encore atteint, est celui qui agirait directement sur le récepteur, avec des effets physiques sur le cerveau.

Aujourd’hui, avec internet, les réseaux sociaux, et désormais la capacité à produire massivement par intelligence artificielle, on se trouve vraisemblablement au cœur du deuxième stade : celui de la massification par la vectorisation.

La cible de la guerre cognitive, ce sont nos esprits. Elle a reçu différents noms au fil de l’histoire, y compris au cours du XXe siècle. Ce rebranding permanent cache aussi le fait qu’on est bien en peine de définir une politique cohérente face à cette bataille des perceptions, une bataille massive, qui dépasse largement le seul champ guerrier.

La guerre cognitive est souvent présentée comme un phénomène nouveau. Pourtant ses racines remontent à Sun Tzu, aux mesures actives soviétiques, au contrôle réflexif de Vladimir Lefebvre. Qu’est-ce qui est vraiment nouveau aujourd’hui ?

Je ne suis pas très à l’aise avec le terme de guerre cognitive, parce que je pense que c’est une nouvelle façon de nommer un phénomène plus ancien : la bataille informationnelle. Et cette bataille informationnelle, elle est plus aiguë aujourd’hui, mais elle est un domaine d’expertise soviétique de longue date, avec l’héritage de Lénine. Une bataille informationnelle dans le champ politique, théorisée, méthodique, qui acquiert différents noms au cours du XXe siècle.

Ce qui change au début du XXIe siècle, avec internet et les réseaux sociaux, c’est une massification de l’information. Et il y a deux phénomènes distincts.

D’un côté, le récepteur n’arrive plus à faire le tri. Il est exposé à l’information en permanence, et il ne la choisit même plus : c’est l’algorithme qui choisit pour lui. Une intelligence artificielle de recommandation qui sélectionne ce que vous consommez. De l’autre côté, du côté de celui qui veut agir sur les perceptions, la capacité à produire et à massifier l’information est absolument inédite. Créer des portails web, multiplier les comptes sur les réseaux sociaux, là où il y a encore cinquante ans il fallait une rotative, imprimer des tracts, mettre des avions en l’air pour les larguer. Aujourd’hui c’est devenu simple et peu onéreux.

C’est ça, la principale révolution : les réseaux sociaux. Et la deuxième révolution, c’est la capacité à produire massivement par IA, d’abord de l’image, aujourd’hui de la vidéo. On estime qu’il s’est produit autant d’images au premier semestre 2025 que pendant tout le XXe siècle. Un trillion. Un million de milliards1. Et la capacité à générer de la vidéo, qui n’existait quasiment pas il y a cinq ans, est désormais là. C’est inquiétant !

Quelle est la différence réelle, sur le terrain, entre InfoOps, PsyOps, StratCom et guerre cognitive ? Ces distinctions ont-elles encore un sens opérationnel ?

Il y a un article très intéressant, paru dans Small Wars Journal et signé par John Wilcox et Ryan Walters, qui explique justement que les États-Unis ont un problème de gouvernance de leur guerre informationnelle. Et que pour pallier ce problème, on procède à du rebranding : on parle successivement de communication stratégique, puis d’InfoOps, puis aujourd’hui de guerre cognitive. Les auteurs expliquent que ce changement sémantique ne suffit pas à combler le retard. Le problème est structurel : le domaine est très réactif, il exige une supervision centralisée parce que c’est très sensible, et en même temps une exécution distribuée parce que ça va très vite.

Je suis assez en phase avec leur analyse. On parle toujours de la même chose : une bataille informationnelle. Si on adopte le prisme doctrinal, il existe bien une doctrine StratCom au sein de l’OTAN, qui recouvre plusieurs domaines d’action, dont le PsyOps, dont l’InfoOps, et ces domaines sont concomitants. Mais l’enjeu final reste identique : communiquer de manière appropriée, massivement, et suffisamment vite.

Dans les démocraties, où on est particulièrement vigilant sur la manière dont l’information institutionnelle est diffusée, il y a un véritable enjeu de gouvernance et de réactivité. Et c’est précisément pour ça qu’on assiste à ces changements d’appellation successifs, pour tenter de mieux cerner un phénomène complexe, qui touche plusieurs sphères et dépasse largement le seul domaine militaire.

Quels sont les biais les plus systématiquement exploités dans les opérations d’influence contemporaines ?

Je ne le vois pas vraiment comme une liste de biais, plutôt comme une chaîne psychologique.

Le premier maillon, c’est capter l’attention. Pour ça, il faut un sujet qui interpelle l’audience : la curiosité, l’intérêt immédiat.

Le deuxième maillon, c’est ce que j’appelle l’enveloppe cognitive. La désinformation se propage rarement à nu, elle se propage sous les oripeaux de quelque chose qui intéresse l’audience, ou mieux encore, de quelque chose avec lequel l’audience est déjà partiellement d’accord. En d’autres termes, quelque chose qui épouse les archétypes de la cible. Pour nous, Français, un archétype très efficace sur les réseaux, c’est, malheureusement, l’idée que les institutions françaises ne sont pas à la hauteur, qu’Emmanuel Macron se prend pour Napoléon. C’est un terrain idéal pour faire passer de la désinformation.

Le troisième maillon, c’est l’émotion. Une fois l’enveloppe en place, pour s’assurer que le message se propage, il faut faire réagir l’audience. Et les meilleurs leviers pour ça, ce sont les émotions fortes : la colère, l’indignation, la honte, le dégoût, l’empathie. L’idée, c’est d’amener l’audience à agir, à partager, à commenter, à réagir.

Donc : un sujet qui présente un intérêt pour la cible, un traitement qui épouse ses archétypes, et un déclencheur émotionnel. C’est la séquence.

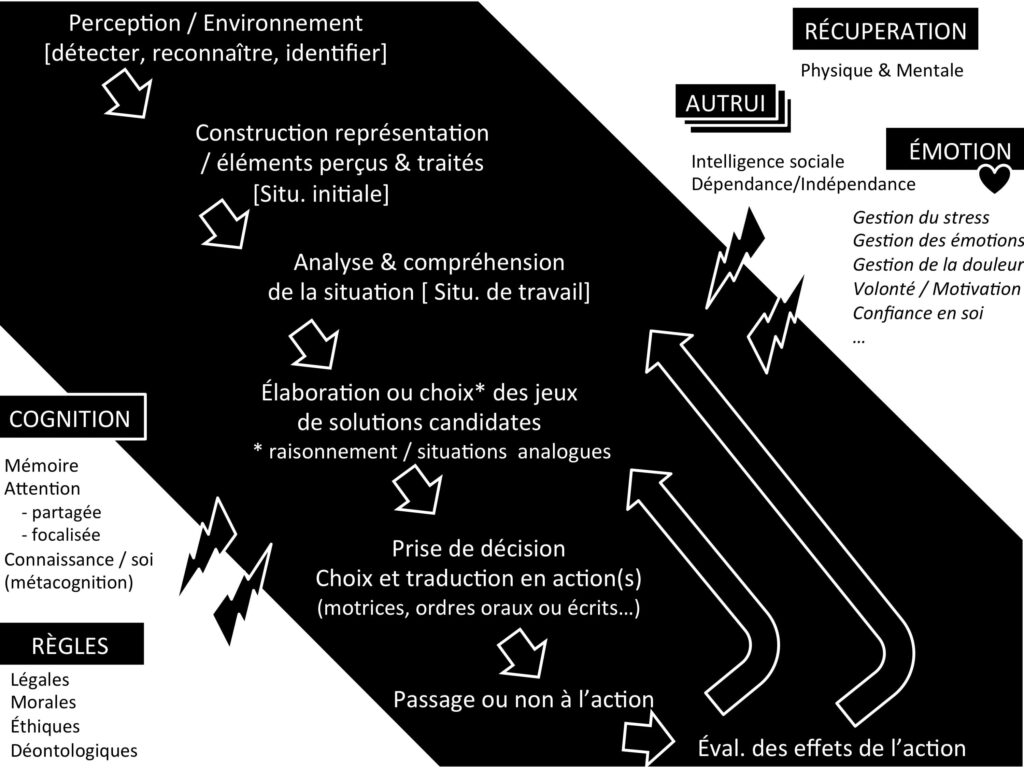

La boucle OODA (observer, s’orienter, décider et agir) est au cœur de la pensée militaire sur la décision. Comment la guerre cognitive cherche-t-elle à la perturber et à quel maillon est-elle le plus vulnérable ?

Elle est vulnérable sur tous les maillons. Pour moi qui ai travaillé sur les biais cognitifs dans la prise de décision, quand vous décomposez le cycle, observer, s’orienter, décider, agir, vous pouvez être biaisé à chaque étape.

Sur l’observation, le levier le plus efficace, c’est la saturation informationnelle. Vous noyez l’adversaire sous le flux. Et si vous êtes suffisamment puissant, si vous dirigez une plateforme très fréquentée, vous pilotez carrément ce que l’audience perçoit.

Sur l’orientation, c’est-à-dire la manière dont la cible va cadrer sa décision, vous pouvez agir sur l’algorithme. Si vous êtes propriétaire d’une plateforme et que vous modifiez ses paramètres de recommandation, disons que vous êtes américain et propriétaire de la plateforme X, vous orientez le panorama donné à voir à l’audience. Vous orientez donc indirectement sa décision.

Sur la décision elle-même, le levier le plus caractéristique, c’est la dissuasion, la menace de représailles. C’est ce qu’a pratiqué la Russie au déclenchement de la guerre en Ukraine : une menace de représailles très forte, destinée à paralyser les velléités de réaction.

Sur l’action enfin, le levier, c’est la mobilisation par l’émotion.

Ce tour d’horizon le montre clairement : on peut agir sur l’ensemble du cycle. Sur l’observation par la saturation, sur l’orientation en cadrant ce que la cible perçoit, sur la décision en la dissuadant, sur l’action en mobilisant ses émotions. Le levier le plus facilement actionnable aujourd’hui, pour n’importe quel acteur, c’est ce dernier : susciter des émotions fortes dans l’information qu’on propage. Pas besoin de ressources massives. C’est accessible.

Comment un commandant militaire peut-il conserver une lucidité décisionnelle dans un environnement saturé de narratifs adverses, de deepfakes, et d’informations dont la fiabilité est impossible à établir immédiatement ?

Il n’y a précisément pas de garantie.

La première condition, c’est de disposer d’une information recoupée. Une des forces de l’outil militaire, c’est qu’en état-major, il existe un bureau renseignement dont la mission est précisément de collationner les informations, de les recouper, d’en vérifier l’authenticité. Et globalement, ils évitent de s’informer sur les réseaux sociaux pour prendre leurs décisions. C’est peut-être ça, la première mesure contre l’intoxication : disposer de sources fiables, recoupées, et de capteurs directs contrôlés.

Mais il n’y a jamais de garantie. Et d’autant moins que la prise de décision militaire s’inscrit par définition dans un environnement volatile, incertain, complexe et ambigu, ce sont précisément les conditions qui induisent des biais cognitifs. C’est là la différence fondamentale entre le chef militaire et le citoyen lambda : le chef militaire dispose, au moins en théorie, de filtres institutionnels qui l’isolent du flux brut. Le citoyen, lui, n’en a pas.

Le contrôle cognitif des territoires occupés en Ukraine (remplacement des programmes scolaires, destruction des archives, russification des noms de lieux) est-il selon vous la forme la plus durable et la plus grave de la guerre cognitive russe ?

Il y a quelque chose que vous n’évoquez pas : le contrôle des boucles Telegram. C’est une mesure immédiate, et elle est redoutablement efficace. En multipliant les canaux pro-Kremlin sur un territoire donné, vous créez un faux panorama numérique. L’audience a l’impression, par simple effet de masse, que l’opinion est massivement ralliée aux thèses russes. Et par conformisme social, elle devient perméable à ces thèses. C’est ce qu’on observe dans les territoires occupés : la population n’a finalement pas d’autre récit disponible dans l’espace numérique que le narratif russe.

Cela dit, l’aspect le plus durable, celui qui façonne le plus profondément les audiences, c’est effectivement celui qui mobilise les outils culturels et éducatifs. Les programmes scolaires sont plus longs à mettre en place, mais leurs effets s’inscrivent dans le temps long.

Et d’ailleurs, quand on parle de guerre cognitive, on a tendance à ne voir que la menace immédiate, la menace russe. Mais l’enjeu du soft power peut revêtir des formes beaucoup plus diffuses et de plus longue haleine. Hollywood est aussi un vecteur d’influence massif, d’une durée et d’une portée sans commune mesure avec la politique conduite par la Russie dans les territoires occupés.

La Chine pratique une guerre cognitive d’un autre type que la Russie : moins destructive à court terme, plus patiente, fondée sur l’influence économique, les diasporas, les partenariats médiatiques. Comment la caractérisez-vous ?

Le parallèle qui s’impose, c’est celui entre les échecs et le jeu de go. Les échecs, c’est une action directe, on abat les pièces de l’adversaire pour servir ses buts de guerre. La Chine, elle, joue au go : elle occupe le terrain très progressivement, en évitant la confrontation directe. Ça se fait toujours en douceur. La force, elle est exercée en priorité contre leurs ressortissants ou leur diaspora, rarement de manière directe contre l’adversaire. C’est complètement protéiforme. Et c’est une manœuvre de beaucoup plus longue haleine, mais pas moins dangereuse pour autant.

Dans un scénario de crise autour de Taïwan, quelles seraient selon vous les premières manœuvres cognitives chinoises et vers quels publics seraient-elles prioritairement orientées ?

La manœuvre la plus immédiatement contrôlable par la Chine, c’est la manœuvre numérique. En diffusant assez subitement sur TikTok les contenus adéquats pour soutenir le récit d’une réunification, ils peuvent obtenir de très gros effets. La cible prioritaire, ce serait évidemment la population taïwanaise.

Mais dans la guerre informationnelle, il n’y a aucune raison de se limiter à une seule cible. Ce n’est pas un tir de sniper. Quand vous contrôlez une plateforme comme TikTok, il n’y a aucune raison de vous interdire de diffuser des contenus spécifiques vers les puissances susceptibles d’interférer, l’Europe, les États-Unis, les puissances occidentales, mais aussi les alliés de la Chine pour appuyer le narratif.

La première manœuvre à laquelle on va assister sera protéiforme selon les pays, mais principalement numérique dans un premier temps. Le domaine numérique offre sur nos sociétés une surface d’attaque cognitive absolument monstrueuse et immédiate. La Chine aurait tort de ne pas l’exploiter.

L’IA agentique change-t-elle qualitativement la guerre cognitive, ou amplifie-t-elle simplement des mécanismes déjà existants à une vitesse et une échelle inédites ?

Je n’ai pas une pratique quotidienne de l’IA agentique, mais je dirais que les progrès en matière de confection de contenu se jouent sur deux axes : l’ergonomie, et la qualité du contenu. L’IA agentique améliore les deux. Sur l’ergonomie, parce que vous n’avez plus à redonner un cadre à chaque itération, il y a un gain de vitesse et de précision. Sur la qualité, parce que l’IA agentique est rendue possible par le fait que l’IA est désormais assez mature pour produire des contenus convaincants.

Cela dit, je n’y vois pas une révolution en tant que telle. Je vois simplement une IA qui continue de s’améliorer, d’être plus performante, et toujours plus convaincante. Et c’est précisément ça, le danger dans la lutte informationnelle.

Comment l’armée française prépare-t-elle ses officiers à la guerre cognitive ? Et l’École de guerre, lieu de formation de ses futurs chefs, lui accorde-t-elle la place qu’elle mérite face aux autres disciplines stratégiques ?

Je pense qu’il y a un véritable enjeu autour de la prise de décision et de la guerre cognitive que les armées mesurent. Mais cet enjeu dépasse le simple champ cinétique et militaire, et c’est précisément pour ça que sa prise en compte est si difficile. On n’en est qu’aux prémices. Certains pensent que rien n’a changé depuis Sun Tzu. D’autres que c’est révolutionnaire, mais que ça ne concerne pas le champ militaire parce que c’est politique (political warfare). Et c’est là toute la difficulté : comprendre que la continuation de la guerre par de nouveaux moyens, liés à la manière dont l’information se propage et donc dont le pouvoir s’exerce, reste une affaire éminemment politique. C’est peut-être la raison principale pour laquelle c’est si délicat pour les armées de s’en emparer.

Vous êtes militaire depuis près de 20 ans, à quel moment avez-vous perçu une bascule, une prise de conscience sur le sujet au sein des armées ?

Clairement, depuis l’apparition de la sixième fonction stratégique d’influence en 2022 dans le discours du président de la République, suivie immédiatement par la création de la cellule ASO (anticipation stratégique et orientations) : qui pilote les logiques d’influence et de lutte informationnelle pour le ministère des Armées. C’est une première bascule assez notable.

Par ailleurs, au niveau des officiers, le thème des biais dans la prise de décision exerce un attrait réel. Il me semble qu’il y a une fracture générationnelle : une ancienne école, convaincue qu’un bon officier n’est pas influençable et que la volonté suffit, et une nouvelle école qui reconnaît qu’on est quand même biaisé, que les réseaux sociaux facilitent cette exposition. Les militaires s’en rendent compte, comme les citoyens, avec l’usage quotidien des réseaux.

Bascule, donc, mais est-on pour autant performant ? Il reste beaucoup à faire pour qu’il existe une filière RH dédiée, des financements, des moyens. Et surtout, moins de timidité dans l’engagement.

L’armée française recrute dans une société de plus en plus fragmentée cognitivement. Comment garantir la cohésion d’une force qui provient d’une population elle-même exposée à des bulles informationnelles opposées ?

La cohésion de la force s’éprouve à la réalité physique de la vie en unité. Une fois recrutées, les personnes expérimentent quelque chose de réel, de tangible, qui prend du temps et qui structure. J’aurais tendance à penser que la désinformation a finalement peu de prise face à l’esprit de corps d’une troupe qui vit soudée en permanence. C’est ça qui crée la cohésion.

Sur le recrutement lui-même : oui, les auditoires sont éclatés, à l’image de notre société. Mais rien n’est perdu. Le recrutement, c’est aussi de l’influence, il faut simplement trouver le bon vecteur pour atteindre l’auditoire et susciter l’envie de s’engager. Quel que soit le milieu d’origine, il y a un levier. D’où le recours aux influenceurs pour porter les messages de recrutement, ce sont des techniques d’influence éprouvées, qui fonctionnent assez bien depuis quelques années.

La guerre cognitive touche autant les civils que les militaires. Les armées peuvent-elles et doivent-elles jouer un rôle dans la résilience cognitive de la société, et si oui, comment ?

Je pense que les armées ont un temps d’avance sur la prise de conscience de la menace informationnelle. Et à ce titre, elles peuvent jouer un rôle pédagogique, mieux caractériser les dangers, diffuser cette expertise. C’est d’ailleurs le sens de ce que j’essaie de partager sur LinkedIn, avec des supports en libre accès, téléchargeables librement.

L’armée n’est pas seule sur ce terrain. L’Éducation nationale se penche aussi sur ces questions de résilience informationnelle. Mais je pense qu’on peut encore progresser, avec une sensibilisation plus systématique, à tous les âges. Un peu à la manière de ce que proposent certains pays scandinaves.

Vous explorez depuis plusieurs années nos mécaniques cognitives. Y a-t-il une découverte, sur nous-mêmes, sur nos biais, sur notre fragilité, qui vous a personnellement surpris ou dérangé ?

Peut-être ce que disait Daniel Kahneman, psychologue spécialiste des biais dans la prise de décision. Une de ses affirmations, au soir de sa vie, c’est que le fait d’avoir travaillé sur les biais pendant plus de soixante ans ne l’avait pas rendu lui-même moins biaisé. C’est peut-être ça le plus frappant.

Travailler dessus, le théoriser, ça vous rend meilleur pour reconnaître les phénomènes. Je pense que je suis mieux capable qu’un citoyen lambda de détecter un contenu conçu pour jouer sur l’émotion, ou fabriqué pour propager de la désinformation. Pour autant, je ne suis évidemment pas moi-même à l’abri. J’utilise les réseaux sociaux. Je suis exposé aux algorithmes de recommandation comme tout le monde.

Si vous deviez identifier le scénario de guerre cognitive le plus dangereux pour l’Europe dans les cinq prochaines années, lequel serait-il ou est-il déjà là ?

Je pense qu’il est déjà là ! L’efficacité de la guerre cognitive dépend de la masse à laquelle vous diffusez l’information. Et depuis les Gilets jaunes, on sait que la Russie ne se prive pas d’appuyer sur toutes les fractures susceptibles de faire éclater notre société, nous diviser, susciter le doute, écarter les citoyens du vote, semer la défiance envers les institutions. Pour reprendre la formule du KGB : l’eau creuse la roche goutte à goutte, non par la force.

La guerre cognitive ne revêtira pas l’aspect d’un grand jet d’eau. Il peut y avoir ponctuellement une aspersion massive, au moment d’une invasion de Taïwan, par exemple, de la part de la Chine. Mais globalement, les mécaniques ne vont pas changer. Notre société est déjà la cible d’une guerre informationnelle russe permanente.

Pour citer Vladimir Volkoff : rien n’interdit, dans les démocraties occidentales, de démantibuler la société de l’intérieur. On joue tous les tableaux simultanément : avec les communistes quand il s’agit d’être communistes, avec les identitaires quand il s’agit d’être identitaires. Rouge et noir en même temps. Cette guerre est déjà là, bien présente, et elle s’exerce à tous les niveaux, alimenter la complosphère, nourrir les extrêmes politiques, attiser tout ce qui est de nature à susciter le doute et l’esprit de reddition.

La guerre cognitive peut-elle être “gagnée“, ou est-ce par nature un domaine de compétition permanente sans victoire décisive, une forme de conflit à intensité variable qui n’a ni début ni fin clairement définis ?

Une petite note optimiste d’abord. La mauvaise nouvelle, c’est que cette guerre politique est déjà là. La bonne nouvelle, c’est que la France, au travers de certaines institutions, est quand même bien consciente qu’elle est une cible dans le champ informationnel, et elle s’est dotée d’entités pour caractériser la menace, riposter, et sensibiliser la société. Il faut continuer. « Là où croît le péril croît aussi ce qui sauve », comme disait Friedrich Hölderlin. Et je crois que parce qu’on a vu le danger, on est en train de créer les conditions pour y échapper.

Sur la question de savoir si cette guerre peut être gagnée, Lénine écrivait dans Que faire ? (1902) que le combat politique est bien pire que le combat militaire : il n’y a ni fin définie, ni gagnant, ni perdant. C’est une confrontation permanente, une succession incessante de rounds.

La lutte informationnelle se joue dans un environnement absolument massif, et vous n’atteignez jamais véritablement le rivage. Il faut sans cesse ramer, voir venir les lames de fond, et si vous en êtes capable, créer les conditions pour que votre société suscite elle-même sa propre lame de fond bénéfique.

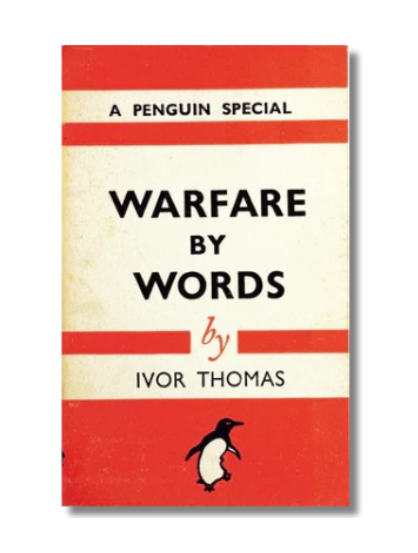

Pour conclure, y a-t-il un livre que vous recommanderiez à quelqu’un qui veut comprendre la guerre cognitive sans être spécialiste ?

Oui, c’est Warfare by Words (1942) dont je suis complètement fan, un obscur opuscule de moins d’une centaine de pages, signé l’officier britannique Ivor Thomas. Il était également rapporteur à la commission défense sur les questions de propagande et de déontologie de la lutte informationnelle, en 1942. À l’époque, la Grande-Bretagne, démocratie en guerre contre l’Allemagne nazie, se posait exactement les mêmes questions que nous aujourd’hui. Et tout ce qu’Ivor Thomas écrit sur la manière dont le combat informationnel doit être mené reste très largement valable.

- Source : Apocalypse cognitive, Gérald Bronner (PUF, 2021) ↩︎

Image © Ministère des Armées