“L’IA doit être considérée comme une série d’applications d’aide à la décision.” Interview de Julien Nocetti (Ifri)

Julien Nocetti, enseignant-chercheur à l’Académie militaire de Saint-Cyr Coëtquidan (AMSCC) et à l’Institut français des relations internationales (Ifri), revient sur l’impact de l’intelligence artificielle dans l’art de la guerre et la diplomatie ou encore la bataille technologique entre les États-Unis et la Chine.

L’intelligence artificielle (IA) est-elle une technique de prise de décision ou une arme ?

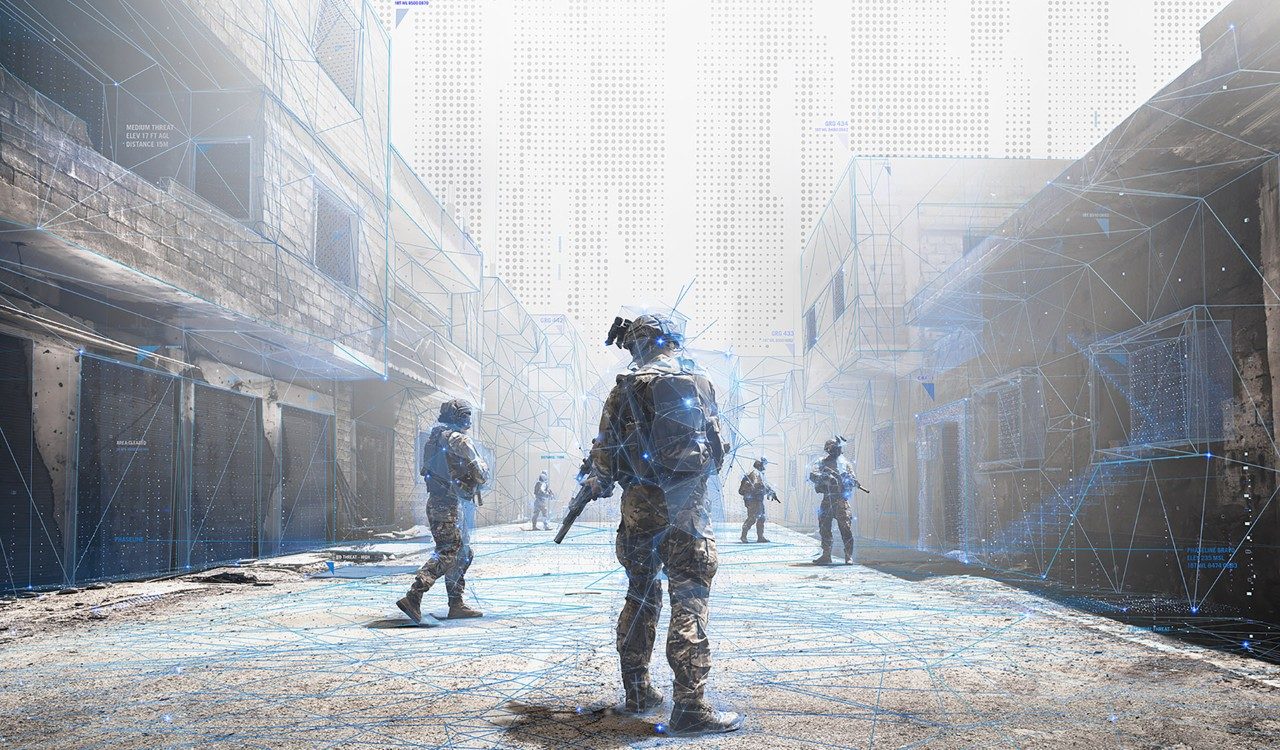

L’IA ne doit pas être considérée comme une technologie à part entière, mais comme une série d’applications d’aide à la décision, d’adjuvant aux armées, aux militaires. À plus long terme, elle implique des perspectives de transformation profondes des champs de bataille, des missions des militaires et des commandements.

Il faut distinguer l’intelligence artificielle dite “facilitatrice”, (appui au renseignement, aide dans les processus de commandement et de contrôle), de l’intelligence artificielle “effectrice” (avec des applications concrètes, comme en cyber ou dans l’engagement des armements). Peu d’États se positionnent dans ce domaine, car cela implique un niveau de sophistication et des moyens financiers très élevés. Seules les grandes puissances sont aujourd’hui capables de s’engager dans cette voie de logiques de planification militaire au long cours.

Est-ce que le conflit en Ukraine marque une évolution du rôle et de l’impact de l’IA dans l’art de la guerre ?

Depuis l’invasion russe, en février, on constate une évolution très notable en matière d’usages de moyens technologiques. Mais il n’y a pas, selon moi, de rupture fondamentale. Dans le cas ukrainien, l’intelligence artificielle appliquée au domaine spatial s’est avérée particulièrement pertinente. La multiplication d’acteurs – principalement américains, mais aussi européens – a permis de développer considérablement le champ d’application de l’OSINT (Open Source Intelligence).

Dans une perspective de transparence du champ de bataille, cet accroissement de l’intelligence artificielle se révèle très pertinent – que ce soit pour les combattants et l’état-major ukrainiens mais aussi les opinions publiques internationales. Aujourd’hui, grâce à l’OSINT, chacun d’entre nous peut avoir connaissance des mouvements des troupes russes et de la localisation de leurs équipements.

Selon vous, l’intelligence artificielle peut-elle affecter la conduite de la diplomatie et, dans un contexte plus large, les relations internationales ?

Totalement. Entre 2017 et 2019, soit juste avant la COVID-19, les attentes placées dans l’IA étaient extrêmement fortes. L’intelligence artificielle devait tout bouleverser sur son passage, nous placer dans un paradigme radicalement nouveau.

Cette lecture, poussée par certains chefs d’États aux maximes à tonalité martiale, n’a pas vraiment aidé à la compréhension fine des implications de l’intelligence artificielle. Certaines enceintes internationales, comme le Forum économique de Davos, ont elles aussi contribué à mythifier les promesses de l’intelligence artificielle. De grands acteurs économiques ont rendu compte de ces attentes, de ces promesses qui allaient modifier les rapports humains et les perspectives économiques, commerciales, et qui conduiraient à créer des millions d’emplois à très court terme.

Depuis, nous avons pris des distances avec cette lecture très optimiste, très schumpétérienne. Nous avons développé un regard plus juste, plus équilibré sur l’IA. Tout d’abord, nous sommes capables d’en percevoir les apports, notamment dans le domaine scientifique. C’est le cas, par exemple, en matière de connaissances météorologiques, avec l’anticipation des changements climatiques, la localisation de feux géants et des zones de déforestation, etc. Nous en percevons aussi davantage les perspectives négatives cette fois. À ce propos, j’en reviens à la dimension de lutte informationnelle. À terme, des intelligences artificielles plus ou moins sophistiquées pourraient permettre de dupliquer rapidement des cyberattaques, de faciliter la création et réplication de faux profils sur les réseaux sociaux et manipuler plus facilement des contenus vidéos.

Nous avons peut-être tous à l’esprit la perspective de vidéos deepfake avec des contenus et des paroles manipulés qui, par leur diffusion virale, pourraient avoir un impact notable sur l’opinion publique. Dans l’état actuel de la technologie, ces contenus deep fake ne sont pas encore tout à fait fins et pertinents pour avoir un effet vraiment crédible sur les opinions publiques.

Au début de l’invasion russe de l’Ukraine, la fausse vidéo du président Volodymyr Zelensky qui a circulé, incitant à la reddition des troupes ukrainiennes, a néanmoins pu donner un aperçu de ce que pourraient être des usages de vidéos deep fake dans un conflit militaire. La vidéo était grossièrement trafiquée, donc peu crédible. Mais demain, nous pouvons très bien imaginer des vidéos deep fake de présidents de puissance dotée annonçant le recours à l’arme nucléaire contre la Russie, dans le conflit ukrainien, engendrant une série d’escalades et de manœuvres militaires plus ou moins dangereuses.

Il ne faut pas escompter un rattrapage technologique européen dans les quatre à cinq ans à venir, mais à beaucoup plus long terme.

Julien Nocetti (Ifri)

L’US Air Force a expérimenté des combats aériens entre un avion de chasse piloté par un humain et son équivalent évoluant grâce à une IA. La Chine n’est pas en reste sur le sujet. Si la relation conflictuelle entre les États-Unis et la Chine perdure, sommes-nous condamnés à évoluer vers des armées d’IA ?

Les politiques des États-Unis, de la Chine et de la Russie, tendent depuis des années à écarter l’humain des champs de bataille, mais nous sommes encore loin de théâtres militaires saturés de robots tueurs qui ont totalement annihilés toute présence humaine. Il faut se distancer d’une science-fiction qui a parfois contribué à brouiller un peu les repères en la matière.

Dans le cadre de cette compétition sino-américaine, cette course technologique est tout à fait prééminente. De part et d’autre, l’objectif est bien d’aller vers une sophistication croissante des matériels militaires engagés. Côté chinois, nous nous dirigeons véritablement vers un engagement des systèmes d’armes (terrestre, naval, etc.) totalement autonomes. Les finalités militaires qui sont envisagées par la Chine sont dirigées vers cette autonomisation, ce qui, d’un point de vue technologique, est perçu avec une grande anxiété côté américain.

Par ailleurs, la menace n’est pas uniquement militaro-technologique mais aussi commerciale. Nous avons pu le constater il y a quelques années avec l’affaire de la 5G. Ajoutons à cela, la dimension civilo-militaire avec la problématique des semi-conducteurs. Une bonne partie de “l’effort de guerre” porté par les Américains est d’asphyxier le renouvellement par la Chine de ses propres semi-conducteurs, notamment les plus sophistiqués, ceux qui peuvent être intégrés dans des systèmes d’armes avec des applications d’IA.

Nous sommes face à une donnée majeure qui est l’intégration, par les États-Unis, de toute une série de moyens de coercition qui doivent leur permettre de conserver leur leadership technologique (donc militaire), de contraindre la Chine et d’empêcher qu’elle ne devienne le leader mondial en 2049. C’est l’horizon annoncé par Pékin pour dépasser les États-Unis en matière militaire, commerciale et technologique.

En 2019, vous indiquiez que le temps dont disposait l’Europe pour rattraper le retard vis-à-vis de la Chine et des États-Unis en matière d’IA était compté. Trois ans après, où en est-on ? La bataille est-elle perdue ?

En matière technologique et numérique, les Européens se perçoivent toujours en retard par rapport aux écosystèmes américains et chinois qui franchissent des paliers en termes de financement et d’innovations de rupture – ce qu’en Europe on a beaucoup plus de difficultés à faire.

La problématique de l’autonomie des matériels, de la robotique ou du soldat augmenté a donné lieu en France et à Bruxelles à toute une série de consultations et de rapports qui traduit la mise en avant d’une conception très européenne de l’éthique, fondée sur ses valeurs. Ce qui n’est d’ailleurs pas sans créer un point de tension, en Europe. Cette mise en avant de l’éthique est critiquée – notamment dans le milieu économique – au prétexte qu’elle contraindrait l’éclosion de géants technologiques, et permettrait aux acteurs américains et chinois d’aller prendre des parts de marché dans l’intelligence artificielle comme dans d’autres domaines technologiques.

A côté de cela, lorsque nous analysons aussi cette perspective d’intelligence artificielle en Europe, il ne faut pas oublier la question des puissances de calculs ou des semi-conducteurs, qui, a donné lieu à une série d’initiatives qui doivent permettre à l’UE de rattraper son retard, financées de façon bien plus importante qu’auparavant. Mais nous sommes toujours dans cette logique de rattrapage. Il ne faut pas escompter un rattrapage technologique européen dans les quatre à cinq ans à venir, mais à beaucoup plus long terme. Nous pourrions voir les premiers signes de cet éventuel rattrapage technologique européen à l’horizon 2035-2040.

Mais si nous prenons les différents États membres : la France, l’Allemagne – le Royaume-Uni étant logiquement à part – nous sommes face à des États qui ont su “prendre le train” avec le développement de niches d’excellences qui sont tout à fait remarquables, notamment en France avec des applications spatiales et cyber très perfectionnées. Tout cela dessinant une sorte de toile de fond qui fait que l’Europe n’est pas absente de la carte mondiale de l’IA. C’est tout de même une dimension à rappeler car on a parfois un discours – notamment politique – qui est très pessimiste, empreint d’une forme de défaitisme technologique et ce n’est pas en conservant ce type de rhétorique narrative que l’on pourra dépasser les faiblesses structurelles de l’Union Européenne en matière technologique.